支付平台的后台监控突然亮起红灯:一笔大额交易已经完成,但商户系统没有收到任何通知。检查日志发现,Webhook请求确实发出去了——服务端返回了200 OK。然而商户的后端工程师打开他们的系统,事件从未被处理。

这不是个案。Hookdeck在处理超过1000亿次Webhook投递后发现,生产环境中Webhook的失败率远比大多数人想象的要高。一项针对生产系统的调查显示,高峰期Webhook失败率可达12%——每八个事件中就有一个可能出问题。Atlassian要求其市场应用维持99%的Webhook投递成功率,反过来说,即便达标,每100次请求仍有1次失败。

Webhook看起来简单:服务端发送HTTP POST请求,客户端返回200,完事。但正是这种表面上的简单,掩盖了分布式系统中最棘手的可靠性问题。网络连接可能在中途断开,服务端可能在发送响应前崩溃,客户端可能在处理事件时超时。每一种失败场景都可能导致同一个结果:事件丢失,或者更糟——事件重复处理。

HTTP协议的先天缺陷:一个200响应能说明什么?

当一个Webhook请求返回200 OK时,发送方认为投递成功。但200响应究竟能说明什么?

HTTP协议设计于1989年,其语义模型基于一个核心假设:请求-响应是原子操作。客户端发送请求,服务端处理请求并返回响应。但在Webhook场景中,这个模型被打破。服务端(Webhook发送方)发出请求后,客户端(Webhook接收方)的处理流程可能是:

接收请求 → 验证签名 → 解析JSON → 写入数据库 → 调用外部API → 更新缓存 → 返回200

HTTP响应码只能反映最后一个步骤的结果。在此之前发生的任何失败——数据库连接超时、外部API返回错误、内存溢出——都无法通过响应码传达给发送方。

更棘手的是超时问题。Webhook提供方通常设置极其严格的超时限制:

| 平台 | 超时时间 | 重试策略 |

|---|---|---|

| Shopify | 5秒 | 48小时内指数退避 |

| GitHub | 10秒 | 无自动重试 |

| Stripe | 20秒 | 3天内最多25次 |

| Slack | 3秒 | 指数退避 |

这些数字揭示了一个残酷的现实:如果Webhook处理器需要调用数据库、访问第三方API或执行任何I/O操作,超时几乎是必然的。而超时之后发生的事情,才是真正令人头疼的开始。

重试的双刃剑:从指数退避到抖动算法

超时触发重试,这是所有Webhook平台的基本策略。但重试不是免费的——它会把一次失败的请求放大成多次失败。

2015年,AWS首席工程师Marc Brooker在AWS架构博客上发表了一篇开创性的文章《Exponential Backoff and Jitter》。通过数学模拟,他揭示了一个反直觉的现象:简单的指数退避在客户端数量较多时,不仅不能减少服务器压力,反而会导致更严重的拥塞。

问题在于同步性。当大量客户端同时遇到失败并开始重试时,指数退避让它们在相同的时间点重新发送请求。第一次重试大家都在1秒后,第二次都在2秒后,第三次都在4秒后。这种同步的"重试波"会反复冲击已经过载的服务器。

Brooker的解决方案是抖动(Jitter)——在退避时间中加入随机性。他比较了三种抖动策略:

全抖动(Full Jitter):delay = random(0, base * 2^attempt)

等抖动(Equal Jitter):delay = base * 2^(attempt-1) + random(0, base * 2^(attempt-1))

解相关抖动(Decorrelated Jitter):delay = min(cap, random(base, delay * 3))

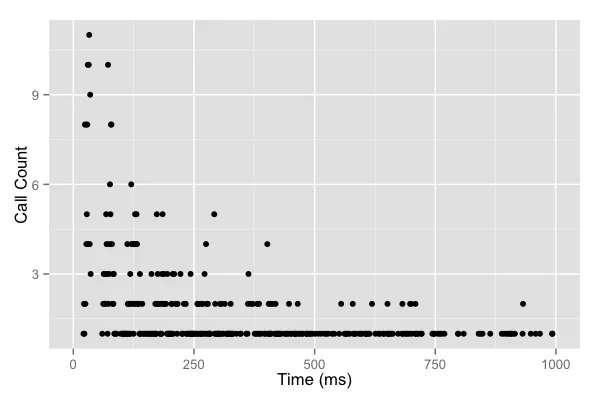

模拟结果显示,在全抖动策略下,100个并发客户端的总请求数减少了超过一半,完成时间也显著缩短。关键在于:随机性打破了同步性,让重试请求在时间上均匀分布,避免了对服务器的集中冲击。

上图展示了添加抖动后的请求分布:原本集中的重试峰值被分散成均匀的流量。图片来源:AWS Architecture Blog

但抖动只是问题的一半解决方案。另一半是重试的分类——并非所有失败都值得重试。

HTTP状态码提供了基本的分类依据:5xx错误表示服务端问题,值得重试;4xx错误表示客户端问题,重试无济于事。但这个界限正在模糊。当服务端返回429 Too Many Requests时,它不是在拒绝请求,而是在请求发送方"慢下来"。正确处理429需要对Retry-After响应头的支持,以及更激进的退避策略。

幂等性:重复投递的必然性与应对

重试策略解决了"如何重新发送"的问题,但带来了新问题:同一个事件可能被投递多次。

这是分布式系统中的经典难题,被称为"至少一次投递语义"(At-Least-Once Delivery)。其根本原因在于确认机制的不可靠性:接收方处理完事件后发送200 OK,但这个确认可能在传输过程中丢失。发送方没收到确认,触发重试,接收方收到第二个相同的事件。

Stripe在2017年的工程博客中详细阐述了幂等性设计。核心思路是:既然无法阻止重复投递,就让重复投递变得无害。这需要两个条件:唯一标识符和去重机制。

每个Webhook事件都应该携带一个全局唯一的事件ID。这个ID可以是发送方生成的UUID,也可以是时间有序的Snowflake ID或ULID。接收方在处理事件前,先检查这个ID是否已经被处理过。

async function processWebhook(event) {

const eventId = event.id;

// 使用原子操作检查并设置

const isDuplicate = await redis.set(

`processed:${eventId}`,

'true',

'NX', // 仅当key不存在时设置

'EX', 86400 * 3 // 3天过期,覆盖重试窗口

);

if (!isDuplicate) {

return; // 已处理,跳过

}

// 处理事件

await handleEvent(event);

}

但幂等性设计比这更复杂。上述代码在单个事件上工作良好,但当多个相同事件并发到达时,竞态条件会导致问题。两个请求可能同时通过NX检查,都开始处理。

更健壮的方案是使用分布式锁或数据库唯一约束:

-- 利用数据库唯一约束保证幂等性

BEGIN;

INSERT INTO processed_events (event_id, processed_at)

VALUES ($eventId, NOW())

ON CONFLICT (event_id) DO NOTHING;

-- 只有插入成功才继续处理

IF found THEN

-- 执行业务逻辑

UPDATE orders SET status = $newStatus WHERE id = $orderId;

END IF;

COMMIT;

Stripe的API更进一步,允许客户端在请求中指定幂等键(Idempotency-Key)。服务端存储每个幂等键对应的响应,后续相同幂等键的请求直接返回缓存的响应。这种设计让客户端可以在网络错误时安全地重试,而不用担心重复执行副作用。

事件顺序:Webhook无法保证的契约

幂等性解决了重复问题,但顺序是另一个故事。

Svix的创始人Tom Hacohen在2022年发表了一篇引起广泛讨论的文章《Why You Can’t Guarantee Webhook Ordering》。他的论点看似反直觉:即使Webhook按照严格的顺序发送,接收方仍然可能以错误的顺序处理它们。

原因在于处理时间的差异。假设有两个事件A和B,A先于B发送。如果处理A需要1秒,而处理B只需要10毫秒,那么B可能先于A完成处理。Webhook的HTTP模型是异步的——发送方无法控制接收方的处理顺序。

更根本的问题是失败处理。如果事件A投递失败,发送方应该怎么办?阻塞后续所有事件直到A投递成功?这会导致一条失败的Webhook阻塞整个系统,显然不可接受。跳过A继续发送B?这破坏了顺序保证。

实际生产环境中的解决方案是放弃对顺序的依赖。事件载荷应该包含足够的信息让接收方独立处理,而不是依赖到达顺序。常见模式包括:

版本号或时间戳:每个事件包含实体的版本号或修改时间戳,接收方只处理比自己已知版本更新的事件。

状态机设计:设计状态转换使其与顺序无关。例如,“已付款"和"已发货"两个事件,无论谁先到达,最终状态都是一致的。

瘦载荷模式:Webhook只携带事件ID和类型,接收方通过API获取完整的实体状态。这把顺序问题转化为最终一致性问题。

Stripe的文档明确指出:“Stripe不保证事件按照生成顺序投递。例如,创建订阅可能生成customer.created、subscription.created、invoice.created等多个事件,它们的投递顺序是不确定的。”

架构模式:从同步处理到异步队列

理解了上述问题后,正确的Webhook处理架构应该是怎样的?

最关键的原则是:接收与处理分离。Webhook处理器应该尽快返回200 OK,而不是等待业务逻辑完成。这需要一个中间缓冲层——消息队列。

┌─────────────┐ ┌─────────────┐ ┌─────────────┐

│ Webhook │────▶│ Message │────▶│ Worker │

│ Endpoint │ │ Queue │ │ Processes │

│ (Fast) │ │ │ │ (Slow) │

└─────────────┘ └─────────────┘ └─────────────┘

返回200 持久化 异步处理

这个架构的核心思想是:把Webhook投递的可靠性问题,转化为消息队列的可靠性问题。消息队列系统(如Kafka、RabbitMQ、SQS)已经针对持久化、重试、死信队列等场景做了大量优化,比在HTTP处理层重新发明轮子更可靠。

队列的选择需要考虑几个因素:

持久化:消息必须在确认之前持久化到磁盘,否则进程崩溃会丢失事件。

可见性超时:消费者获取消息后,如果在一定时间内没有确认,消息应该重新变为可见,让其他消费者处理。这防止消费者崩溃导致消息丢失。

死信队列:经过多次重试仍然失败的消息应该转移到死信队列,而不是无限重试。死信队列需要人工介入或特定脚本来处理。

AWS SQS是这一模式的典型实现。它提供了可配置的最大接收次数(maxReceiveCount),超过后消息自动转移到死信队列。Lambda函数可以触发死信队列的处理,实现告警和恢复机制。

# Webhook处理器:快速返回

def handle_webhook(request):

payload = request.body

signature = request.headers.get('X-Signature')

# 快速验证签名

if not verify_signature(payload, signature):

return Response(status=401)

# 立即入队并返回

sqs.send_message(

QueueUrl=WEBHOOK_QUEUE_URL,

MessageBody=payload,

MessageAttributes={

'ReceivedAt': {'StringValue': iso_now(), 'DataType': 'String'}

}

)

return Response(status=200)

# 后台Worker:实际处理

def process_webhook(message):

event = json.loads(message['Body'])

event_id = event['id']

# 幂等性检查

if already_processed(event_id):

return

# 业务处理

process_event(event)

# 标记已处理

mark_processed(event_id)

安全考量:签名验证与重放攻击

Webhook的另一个可靠性维度是安全性。由于Webhook是通过公开HTTP端点接收请求,任何人都可以向该端点发送伪造的请求。没有签名验证,系统无法区分真正的Webhook和恶意请求。

行业标准是HMAC-SHA256签名。发送方使用预共享密钥对请求体进行哈希,将结果放入签名头。接收方使用相同的密钥重新计算哈希,比对是否一致。

import hmac

import hashlib

def verify_signature(payload, signature_header, secret):

# 签名头格式:sha256=<hex_digest>

expected = 'sha256=' + hmac.new(

secret.encode(),

payload,

hashlib.sha256

).hexdigest()

# 使用常量时间比较防止时序攻击

return hmac.compare_digest(expected, signature_header)

时序攻击是一个容易被忽视的漏洞。如果使用普通的字符串比较(==),攻击者可以通过测量响应时间逐字符推断正确的签名。hmac.compare_digest函数保证无论多少字符匹配,比较时间都相同。

签名验证解决了请求来源问题,但还有另一个攻击向量:重放攻击。攻击者截获一个合法的Webhook请求,稍后重复发送。

防御重放攻击需要在签名中加入时间戳,并验证请求的新鲜度:

def verify_with_replay_protection(payload, signature_header, secret, max_age_seconds=300):

# 解析时间戳

timestamp = extract_timestamp_from_payload(payload)

# 检查时间窗口

if abs(time.time() - timestamp) > max_age_seconds:

raise ReplayAttackError("Request too old")

# 正常签名验证

return verify_signature(payload, signature_header, secret)

更健壮的方案是维护一个短期缓存,记录已处理的事件ID或签名。即使时间戳验证通过,重复的事件ID也应该被拒绝。

从失败中恢复:监控与告警

即使采用了上述所有最佳实践,Webhook仍然可能失败。关键是要知道何时失败、为什么失败。

Webhook系统需要监控以下核心指标:

投递成功率:成功返回2xx的请求占总请求的比例。这是最直观的健康指标。

延迟分布:P50、P95、P99的响应时间。异常高的P99可能预示着下游系统问题。

重试率:需要重试的请求比例。高重试率可能表示网络问题或下游系统过载。

死信队列深度:累积的失败事件数量。持续增长的死信队列需要人工介入。

端点健康度:每个订阅者端点的独立成功率。一个端点的故障不应影响其他端点。

告警策略应该基于业务影响。对于支付相关的Webhook,任何失败都应该触发告警。对于分析类Webhook,可以容忍更高的失败率。

Hookdeck在处理1000亿次Webhook后的经验是:很多Webhook失败有规律可循。周一早上部署后的失败高峰、节假日流量激增导致的超时、证书过期导致的签名验证失败——这些模式都可以通过监控发现并预防。

最佳实践清单

综合以上分析,可靠的Webhook系统需要在发送方和接收方两个层面实施以下措施:

发送方责任:

- 持久化每个事件后再尝试投递,确保失败后可恢复

- 实现指数退避加抖动的重试策略

- 设置合理的最大重试次数和总时间窗口

- 区分可重试错误(5xx、超时)和不可重试错误(4xx)

- 提供死信队列或失败事件列表供人工恢复

- 在每个事件中包含全局唯一的事件ID

- 使用HMAC签名验证请求来源

- 提供事件API供客户端主动拉取,不依赖推送

接收方责任:

- 实现快速响应模式,收到请求后立即入队并返回200

- 使用事件ID实现幂等性处理

- 处理乱序到达的事件,不依赖投递顺序

- 验证签名并防御重放攻击

- 监控处理延迟和失败率

- 对关键事件实现补偿机制,定期对账

Webhook看似简单,实则触及了分布式系统中最核心的可靠性问题:网络不可靠、时钟不同步、状态不一致。理解这些问题及其解决方案,不仅是实现可靠Webhook的关键,也是构建任何分布式系统的基础。

参考资料

- Marc Brooker. “Exponential Backoff And Jitter.” AWS Architecture Blog, 2015.

- Stripe. “Designing robust and predictable APIs with idempotency.” Stripe Blog, 2017.

- Tom Hacohen. “Why You Can’t Guarantee Webhook Ordering.” Svix Blog, 2022.

- AWS. “Timeouts, retries and backoff with jitter.” Amazon Builders’ Library, 2019.

- Hookdeck. “Webhook Retry Best Practices.” Hookdeck Documentation, 2024.

- Svix. “Webhook Timeout Best Practices.” Svix Resources, 2024.

- GitHub. “Best practices for using webhooks.” GitHub Documentation, 2024.

- IETF. “The Idempotency-Key HTTP Header Field.” Internet-Draft, 2024.