对比学习如何用"比较"重构神经网络的表示能力

2018年,OpenAI的研究员Alec Radford正在思考一个问题:如何让神经网络理解图像和文本之间的关系,而不需要人工标注的百万级训练数据?传统的监督学习范式需要告诉模型"这是一只猫"、“那是一辆车”,但人类学习概念的方式似乎并非如此。我们通过比较和对比来理解世界——知道什么相似,什么不同,什么属于同一类别,什么截然相反。 ...

2018年,OpenAI的研究员Alec Radford正在思考一个问题:如何让神经网络理解图像和文本之间的关系,而不需要人工标注的百万级训练数据?传统的监督学习范式需要告诉模型"这是一只猫"、“那是一辆车”,但人类学习概念的方式似乎并非如此。我们通过比较和对比来理解世界——知道什么相似,什么不同,什么属于同一类别,什么截然相反。 ...

2024年5月,OpenAI发布GPT-4o,这个模型能实时"看"你手机屏幕上的内容并回答问题。对着一张复杂的电路图问"这个电阻的阻值是多少",它能准确定位并读出数值;给它一张手绘的流程图,它能理解逻辑关系并生成代码实现。 ...

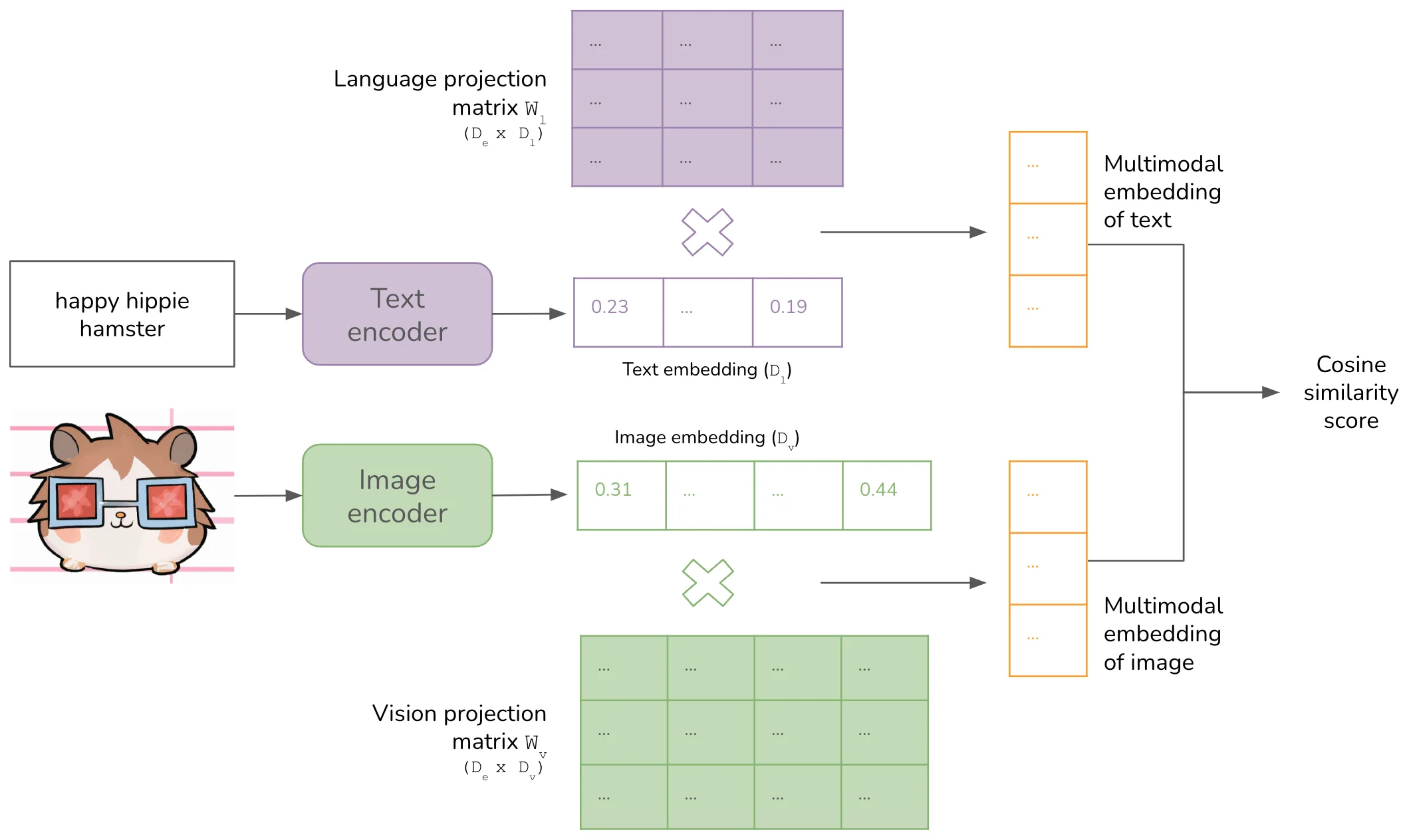

2021年1月5日,OpenAI发布了一篇看似普通的论文。论文标题很长——《Learning Transferable Visual Models From Natural Language Supervision》,但核心贡献可以用一句话概括:用4亿对网络图片和描述文本,训练出了一个能"看懂"图像的模型。这个模型叫CLIP,它没有在当时引起轰动,却在随后的五年里重塑了整个人工智能领域的技术路线。 ...

2022年夏天,一幅AI生成的图像在互联网上疯传:画面中央是一位女性,她的右手有七根手指,左手的手指像融化的蜡烛一样缠绕在一起。这不是某个先锋艺术家的刻意创作,而是当时最先进的图像生成模型DALL-E 2的"杰作"。 ...