2023年1月,马里兰大学的研究团队在arXiv上发表了一篇论文,标题很朴素:《A Watermark for Large Language Models》。但论文中的一个演示却引发了广泛关注:一段仅56个单词的文本,因为嵌入了水印,被算法以约 $6 \times 10^{-14}$ 的概率判定为机器生成——这个概率比连续中两次彩票头奖还要低。

这不是魔法,而是数学。在水印技术的背后,是一整套精巧的统计学框架,它可以在不改变文本外观的情况下,让AI生成的内容带上一个"隐形身份证"。

但水印技术真的能解决AI内容检测的难题吗?它的原理是什么?又面临哪些无法回避的挑战?

为什么AI生成内容如此难以检测?

要理解水印技术的价值,首先需要理解AI内容检测的根本困境。

传统的检测方法,如GPTZero、DetectGPT等,采用的是"事后分析"策略:训练一个分类器,或利用语言模型自身的特性来区分人类文本和机器文本。这些方法的核心假设是:AI生成的文本存在某些统计特征,比如困惑度较低、词汇分布更均匀等。

然而,这个假设正在迅速失效。2022年,Gambini等人的研究就发现,针对GPT-2设计的检测器在面对GPT-3时效果大打折扣。随着模型能力的提升,AI生成文本与人类文本的边界越来越模糊。更麻烦的是,这些检测器往往会对非母语写作者或使用写作辅助工具的人群产生较高的误判率——当检测器说"这段文字不像人写的"时,可能只是在说"这段文字写得太平滑了"。

水印技术提供了一条完全不同的路径:与其在生成后费力区分,不如在生成时就留下标记。

绿红列表:水印的核心机制

2023年,Kirchenbauer等人提出的KGW算法(以作者姓名首字母命名)奠定了大语言模型水印的基础框架。其核心思想极其简单:在生成每个词之前,随机将词汇表分成"绿列表"和"红列表",然后鼓励模型优先从绿列表中选词。

具体来说,语言模型在生成下一个词时,会输出一个概率分布。假设词汇表大小为 $|V|$(通常在5万到10万之间),模型会给每个可能的词分配一个分数(logit),然后通过Softmax转换为概率:

$$p_k = \frac{e^{l_k}}{\sum_{j=1}^{|V|} e^{l_j}}$$KGW算法的关键操作是:在Softmax之前,使用一个伪随机数生成器(PRNG),根据前一个词的哈希值作为种子,将词汇表随机分成两部分——绿列表(大小为 $\gamma|V|$)和红列表(大小为 $(1-\gamma)|V|$)。然后,给绿列表中所有词的logit加上一个常数 $\delta$:

$$\hat{l}_k = \begin{cases} l_k + \delta, & k \in \text{绿列表} \\ l_k, & k \in \text{红列表} \end{cases}$$这个操作的效果是:当模型对下一个词有多种"差不多好"的选择时(高熵情况),它会更倾向于选择绿列表中的词;但当模型非常确定下一个词是什么时(低熵情况),比如"Barack"后面几乎必然是"Obama",即使"Obama"在红列表中,模型仍然会选择它——因为原始logit已经足够大,加上的 $\delta$ 无法逆转这种偏好。

这个设计的精妙之处在于自适应:水印只在"有选择空间"的地方生效,不会强行改变那些语义上已经确定的词。

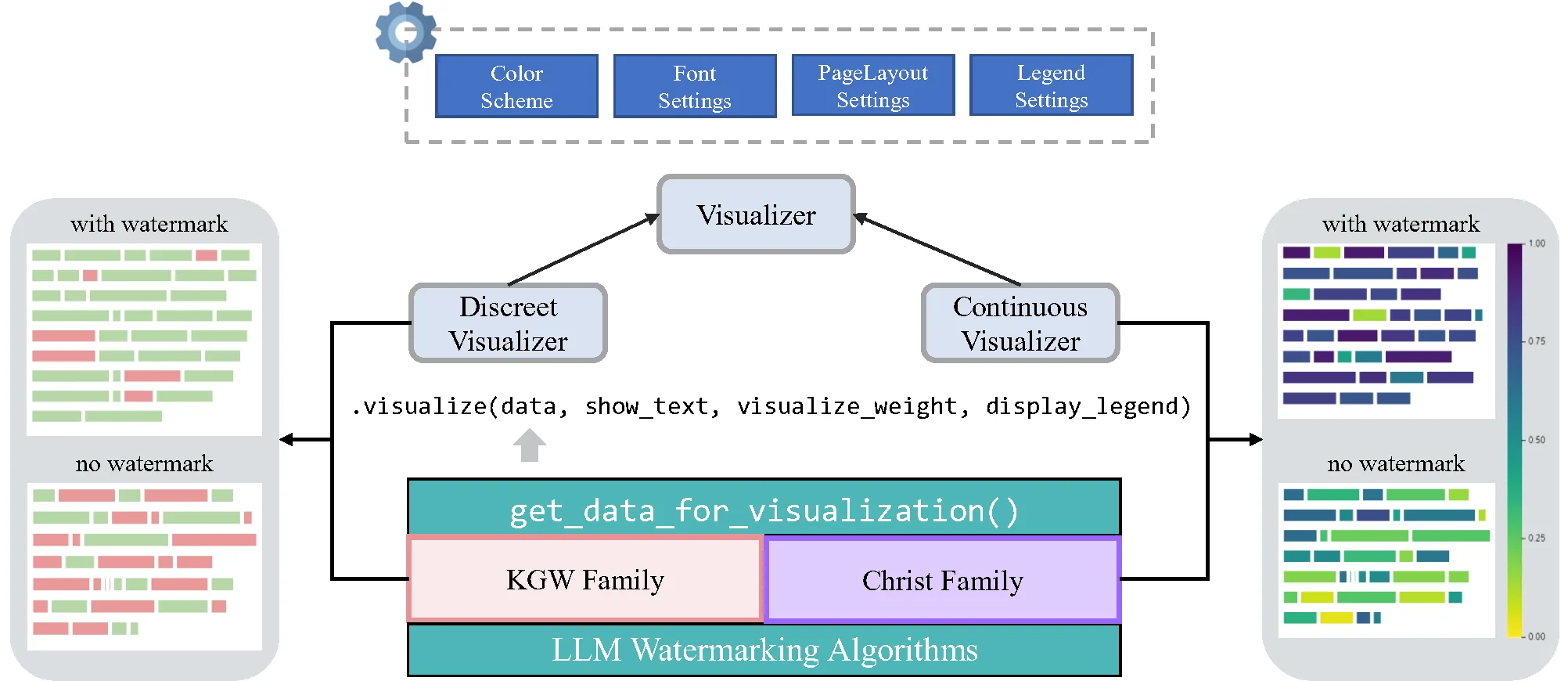

上图展示了水印嵌入与检测的核心机制:绿底色的词来自绿列表,红底色的词来自红列表。水印文本中绿词比例显著高于随机水平。

检测:一场统计假设检验

水印的嵌入是隐形的,但检测却可以有极高的置信度。

检测算法不需要访问原始模型,只需要知道哈希函数和伪随机数生成器的规则。对于待检测的文本,检测器会重新计算每个位置的绿列表,然后统计有多少词落入了绿列表。

假设一段文本有 $T$ 个词,其中 $|s|_G$ 个落在绿列表。如果这段文本是人类写的,那么每个词落入绿列表的概率应该是 $\gamma$(因为列表是随机分配的)。但如果文本是带水印的模型生成的,这个比例会显著高于 $\gamma$。

KGW论文提出了一个简单的假设检验框架。零假设 $H_0$ 是"文本是人类写的",在这种假设下,绿列表词数的期望是 $\gamma T$,方差是 $T\gamma(1-\gamma)$。使用z统计量:

$$z = \frac{|s|_G - \gamma T}{\sqrt{T\gamma(1-\gamma)}}$$如果 $z > 4$,对应的p值约为 $3 \times 10^{-5}$,这意味着假阳性(把人类文本误判为机器生成)的概率只有约十万分之三。在某些设置下,仅需25个词就可以可靠地检测出水印。

三方权衡:质量、可检测性与鲁棒性

水印设计面临一个经典的三方权衡,研究界称之为"不可能三角":

quadrantChart

title 水印设计的三方权衡

x-axis 低可检测性 --> 高可检测性

y-axis 低鲁棒性 --> 高鲁棒性

quadrant-1 理想但难实现

quadrant-2 高质量优先

quadrant-3 不可接受

quadrant-4 高检测性优先

KGW-弱: [0.3, 0.2]

KGW-强: [0.8, 0.7]

SynthID: [0.7, 0.6]

WaterMax: [0.75, 0.65]

理想目标: [0.95, 0.9]

质量(Quality):水印不应该显著降低文本的质量,包括流畅性、连贯性和事实准确性。

可检测性(Detectability):水印应该容易被检测出来,即使只有短文本。

鲁棒性(Robustness):水印应该能抵抗各种攻击,如改写、删除、插入等。

这三个目标之间存在内在张力。更强的水印(更大的 $\delta$ 或更小的 $\gamma$)会更容易检测,但会损害文本质量;更弱的水印可能对文本影响小,但也更容易被攻击者去除。

2024年NeurIPS的一篇论文《Breaking the LLM Watermark Detectability-Robustness-Quality Trade-off》提出了WaterMax方法,试图突破这个困境。其核心思想是:不直接修改logit,而是修改采样温度,让水印在更"自然"的方式下生效。实验表明,WaterMax可以在几乎不损失质量的情况下实现高可检测性。

攻击与防御:一场不对称的战争

水印技术一经提出,攻击方法也随之涌现。最常见的攻击包括:

改写攻击(Paraphrasing):使用另一个语言模型改写带水印的文本,试图破坏水印的统计特征。2024年EMNLP的一篇研究发现,通过有限次访问带水印模型的输出,攻击者可以"逆向工程"水印模式,然后使用改写攻击大幅降低水印的可检测性。

编辑攻击(Editing):删除、插入或替换单词。研究表明,字符级别的攻击(如同形字符替换、零宽字符插入)往往比单词级别的攻击更有效,因为它们可以改变tokenization而不明显影响文本外观。

生成式攻击(Generative Attacks):通过精心设计的prompt,让模型在生成过程中规避水印。例如,“Emoji攻击"要求模型在每个词后加一个emoji,生成后删除emoji即可打乱水印结构。

更令人担忧的是"水印窃取攻击”(Watermark Stealing)。2024年的一项研究发现,只需花费不到50美元,攻击者就可以通过查询API逆向提取出水印的密钥,然后伪造带有该水印的文本——这就是"伪造攻击"(Spoofing)。一旦攻击者掌握了水印密钥,他们可以让任何文本都被检测为"AI生成",从而破坏整个水印系统的可信度。

flowchart LR

subgraph 攻击类型

A[改写攻击<br/>Paraphrasing]

B[编辑攻击<br/>Editing]

C[生成式攻击<br/>Generative]

D[窃取攻击<br/>Stealing]

end

subgraph 攻击效果

E[降低检测率]

F[伪造水印]

end

A --> E

B --> E

C --> E

D --> F

从学术研究到生产部署:SynthID

2024年10月,Google DeepMind在《Nature》上发表了SynthID-Text的技术细节,标志着水印技术首次在大型生产系统中部署。SynthID已在Gemini聊天机器人和Web界面中启用,成为业界首个大规模应用的文本水印方案。

SynthID的核心创新在于引入了一种称为"G值"(G-value)的嵌入机制。不同于KGW简单的绿红列表二分,SynthID使用一个可学习的函数来计算每个token的"水印得分",然后通过调整采样分布来嵌入水印。

SynthID提供了两种检测器:加权均值检测器(Weighted Mean Detector)无需训练,直接计算文本的平均G值;贝叶斯检测器(Bayesian Detector)需要在水印和非水印文本上训练,但提供更高的检测精度。

值得注意的是,SynthID采用了"多层水印"设计:使用多个不同的密钥生成多层水印,检测时只需要匹配其中一层即可。这种设计在提供更强鲁棒性的同时,也增加了攻击者逆向工程的难度。

# SynthID 水印配置示例

from synthid_text import synthid_mixin

CONFIG = {

'ngram_len': 5, # 用于哈希的n-gram长度

'keys': [42, 137, 256], # 多层水印密钥

'sampling_table_size': 65536,

'sampling_table_seed': 0,

}

监管推动:欧盟AI法案的要求

水印技术不仅仅是学术研究,正在成为法律要求。2024年3月正式通过的《欧盟人工智能法案》(EU AI Act)第50条规定:生成式AI系统的提供商必须以机器可读的方式标记其输出为"AI生成"。

这项规定将于2026年生效,这意味着所有在欧盟运营的AI服务都需要在技术上实现内容标记。水印技术因其"无需人工介入、难以去除"的特性,成为满足这一要求的主要候选方案。

然而,法案的要求与现有技术之间存在差距。法案要求的是"可见标记"(visible marking),而水印是"隐形标记"(invisible marking)。如何在保护用户体验的同时满足监管要求,仍是业界需要解决的问题。

水印的局限性:低熵文本的困境

水印技术并非万能。它面临一个根本性的限制:低熵文本无法有效水印。

当一段文本几乎是"唯一解"时——比如"Barack Obama was the 44th president of the United States"——模型没有选择的余地,必须输出特定的词。在这种情况下,无论水印如何设计,都无法嵌入有效的信号。

这导致了一个悖论:越是需要事实准确性的场景(如知识问答),水印越难以生效;而水印效果最好的场景(开放式创意写作),恰恰是最不担心AI滥用的场景。

研究还发现,水印可能会影响模型的某些能力。2024年的一项研究发现,水印会降低模型在知识密集型任务上的表现,因为水印会轻微干扰模型选择"正确"答案的能力。虽然在大多数情况下这种影响很小,但在高风险场景(如医疗诊断辅助)中需要谨慎评估。

未来:水印还是更好的检测器?

水印技术的发展引发了一个更深层的思考:我们真正需要的是什么?

如果目标是检测AI生成内容,水印提供了一种"主动防御"的思路——在源头就埋下标记。但这种方法要求所有AI服务提供商都部署水印,这在竞争激烈的市场中难以保证。

另一种思路是继续改进事后检测器。2024年的研究表明,通过更好的特征工程和模型架构,事后检测器的性能正在逐步提升。但正如前文所述,这是一场注定艰难的追逐——模型越强,检测越难。

最可能的未来是两者结合:大规模商业AI服务部署水印以满足监管要求;同时,针对未部署水印的模型,使用事后检测器作为补充手段。

结语

大语言模型水印是AI安全领域少有的"有数学保证"的技术方案。它不依赖于启发式规则或黑盒分类器,而是基于严格的统计假设检验。从KGW的开创性工作到SynthID的生产级部署,水印技术在过去两年中取得了长足进步。

但水印也不是万能药。它面临低熵文本的根本限制,容易被改写攻击规避,而且依赖服务提供商的配合部署。在可见的未来,AI内容检测仍将是一场攻防双方持续博弈的战争。

唯一确定的是:随着AI能力的提升和监管压力的增大,对AI生成内容进行标记的需求只会越来越强烈。水印技术,作为目前最成熟的解决方案之一,将继续在这场博弈中扮演重要角色。

参考文献

-

Kirchenbauer, J., Geiping, J., Wen, Y., Katz, J., Miers, I., & Goldstein, T. (2023). A Watermark for Large Language Models. ICML 2023. https://arxiv.org/abs/2301.10226

-

Dathathri, S., et al. (2024). Scalable watermarking for identifying large language model outputs. Nature, 634(8035), 818-823. https://doi.org/10.1038/s41586-024-08025-4

-

Giboulot, E., & Furon, T. (2024). WaterMax: Breaking the LLM Watermark Detectability-Robustness-Quality Trade-off. NeurIPS 2024. https://arxiv.org/abs/2403.04808

-

Rastogi, A., & Pruthi, T. (2024). Revisiting the Robustness of Watermarking to Paraphrasing Attacks. EMNLP 2024. https://arxiv.org/abs/2411.05277

-

Jovanovic, N., et al. (2024). Watermark Stealing in Large Language Models. ICLR 2025. https://arxiv.org/abs/2402.16187

-

Aaronson, S. (2022). Watermarking GPT Outputs. Talk at Simons Institute. https://simons.berkeley.edu/talks/scott-aaronson-ut-austin-openai-2023-08-17

-

Pan, L., et al. (2024). MarkLLM: An Open-Source Toolkit for LLM Watermarking. EMNLP 2024 Demo. https://arxiv.org/abs/2405.10051

-

European Union. (2024). Regulation (EU) 2024/1689 (AI Act), Article 50. https://artificialintelligenceact.eu/article/50/