1996年,当John Carmack设计Quake的网络架构时,他面临一个看似不可能的挑战:如何在拨号上网时代(平均延迟200-300毫秒),让玩家获得接近本地游戏的流畅体验?这个问题的答案,最终塑造了接下来三十年实时网络游戏的技术演进路径。

快进到2025年,当你在《英雄联盟》中释放一个技能,或者在《CS2》中完成一次精准爆头,你的客户端实际上正在与服务器进行着极其复杂的"时间旅行"。这些看似简单的交互背后,是无数工程师为解决网络延迟而设计的精妙技术架构。

两种根本不同的哲学

实时游戏的网络同步,本质上是在回答一个问题:如何让多个玩家在不可靠的网络环境中,看到"同一个"游戏世界?

这个问题的答案分化出了两条截然不同的技术路线:帧同步(Lockstep) 和 状态同步(State Synchronization)。它们不仅是技术实现的不同,更是设计哲学的根本分歧。

帧同步:信任客户端的计算

帧同步的核心思想极其优雅:既然网络带宽有限,那就不要传输游戏状态,只传输玩家的输入。每个客户端收到所有玩家的输入后,在本地独立计算游戏状态。

客户端A 服务器 客户端B

| | |

|--- 输入: 向右移动 ------->| |

| |--- 广播所有输入 -------->|

|<-- 广播所有输入 ----------| |

| | |

本地计算游戏状态 本地计算游戏状态 本地计算游戏状态

这种设计的带宽优势极其明显。以《星际争霸》为例,一场游戏可能有数百个单位在移动,如果传输每个单位的状态,数据量会非常庞大。但传输输入?可能只需要每秒几百字节。

但帧同步有一个致命前提:所有客户端的计算必须完全一致。这意味着如果你在客户端A计算的结果是某个单位在位置(100, 200),那么客户端B必须算出完全相同的位置——精确到每一个比特。

这种要求带来了三个层面的挑战:

第一层:浮点数确定性问题

这是帧同步最深层的陷阱。IEEE 754浮点数标准规定了一个有趣的事实:虽然单次运算的结果是确定的,但跨平台、跨编译器的一致性却是个噩梦。

“The ISA is IEEE compliant. If your x87 implementation isn’t IEEE, it’s not x87… Also, you can’t use SSE or SSE2 for floating point, because it’s too under-specified to be deterministic.”

—— Jon Watte, GameDev.net

Gas Powered Games的工程师Elijah分享了他们在《最高指挥官》系列中的实践经验:

“We call

_controlfp(_PC_24, _MCW_PC)and_controlfp(_RC_NEAR, _MCW_RC)at startup… We have never had a problem with the IEEE standard across any PC CPU AMD and Intel with this approach. None of our SupCom or Demigod customers have had problems… over 1 million customers here.”

关键在于:必须严格控制浮点数的精度和舍入模式。不同的编译器优化级别、不同的CPU架构(Intel vs AMD)、甚至不同的指令集(x87 vs SSE)都可能产生微妙差异。

第二层:跨平台一致性

当游戏需要在PC、主机、移动端之间跨平台联机时,问题变得更加复杂。不同平台的CPU架构、编译器、数学库都可能产生细微差异。

Ken Miller在Pandemic Studios的《Battlezone 2》开发中遇到了这个问题:

“AMD and Intel processors produced slightly different results for transcendental functions (sin, cos, tan, and their inverses), so we had to wrap them in non-optimized function calls to force the compiler to leave them at single-precision.”

第三层:玩家数量的限制

帧同步有一个结构性瓶颈:必须等待所有玩家的输入才能推进游戏帧。如果有一个玩家的网络延迟很高,所有人都会被拖慢。

“Because of this, I recommend deterministic lockstep for 2-4 players at most.”

—— Glenn Fiedler, Gaffer On Games

这就是为什么帧同步主要用于RTS游戏(如《星际争霸》、《帝国时代》)和格斗游戏——这些游戏的玩家数量通常较少。

状态同步:服务器的绝对权威

状态同步选择了完全不同的路径:服务器是唯一真理。客户端不再计算游戏逻辑,只是向服务器发送输入,然后等待服务器告诉它们游戏状态是什么。

客户端A 服务器 客户端B

| | |

|--- 输入: 向右移动 ------->| |

| |--- 计算游戏状态 -------->|

|<-- 新的游戏状态 ----------|<--- 新的游戏状态 --------|

| | |

渲染服务器状态 渲染服务器状态 渲染服务器状态

这种设计的优势在于客户端永远可以信任服务器的结果。不需要担心浮点数一致性,不需要等待最慢的玩家。但代价是带宽消耗——服务器需要不断向每个客户端发送完整的游戏状态。

“In video games, patch based replication is sometimes called ‘delta compression’. The technique was popularized by John Carmack, who used it in Quake… Instead of sending the full gamestate, only the differences from the last acknowledged state are transmitted.”

—— 0 FPS Blog

Quake 3的网络架构将这种思想发挥到了极致。服务器为每个客户端维护一个包含32个快照的循环缓冲区,每次发送更新时,都与客户端上次确认接收的快照进行比较,只发送差异数据。

// Quake 3的delta压缩核心逻辑

typedef struct {

char *name;

int offset;

int bits;

} netField_t;

// 使用预处理指令自动生成字段映射

#define NETF(x) #x,(int)&((entityState_t*)0)->x

netField_t entityStateFields[] = {

{ NETF(pos.trTime), 32 },

{ NETF(pos.trBase[0]), 0 },

{ NETF(pos.trBase[1]), 0 },

// ... 更多字段

};

这段代码展示了一个精妙的技巧:在C语言没有反射的情况下,通过预处理指令和指针运算实现了字段映射。服务器可以"盲目地"比较两个字节的内存区域,找出哪些字段发生了变化。

延迟的幻觉:让不可能变为可能

无论选择哪种同步策略,网络延迟都是无法回避的物理现实。光速限制、路由器处理、拥塞控制——这些因素让100毫秒的往返延迟变得司空见惯。如果客户端必须等待服务器确认每一个操作,游戏将变得无法操作。

客户端预测:欺骗玩家的大脑

解决方案既简单又深刻:不要等待服务器,直接预测结果。

Gabriel Gambetta在他的经典文章中解释了这个原理:

“If the game world is deterministic enough, we can send the inputs to the server and immediately process them on the client - that is, we predict what the game state will be after the server has processed the inputs.”

但预测会出错。当玩家按下"向右移动"时,客户端立即显示角色向右移动。但在服务器端,可能因为另一个玩家同时释放了击退技能,角色实际上应该向左飞去。

当服务器的权威状态到达时,客户端发现预测错误,必须"和解"(reconcance)。关键技巧在于:客户端保存所有未确认的输入,收到服务器状态后,从服务器状态开始重新应用这些输入。

时间线:

t=0ms: 客户端发送输入#1(向右),立即预测移动

t=50ms: 客户端发送输入#2(跳跃),继续预测

t=100ms: 服务器回复"基于输入#1,你被击退"

客户端:

1. 更新为服务器状态

2. 重新应用输入#2

3. 得到正确的最终位置

这个过程对玩家是透明的——如果预测准确,他们什么都不会察觉;如果预测错误,客户端会在后台悄悄修正。

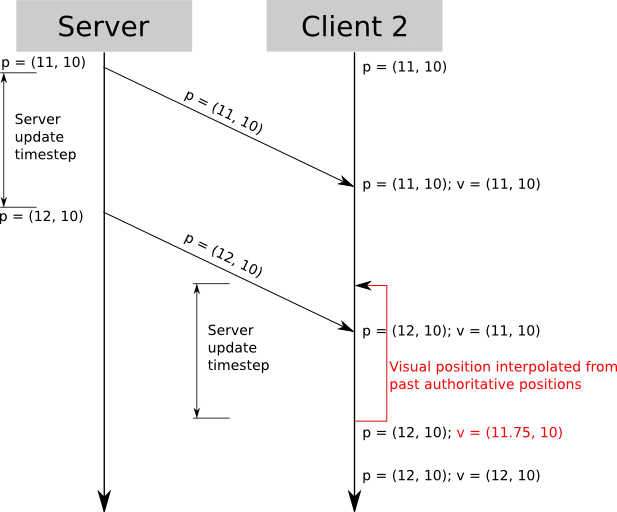

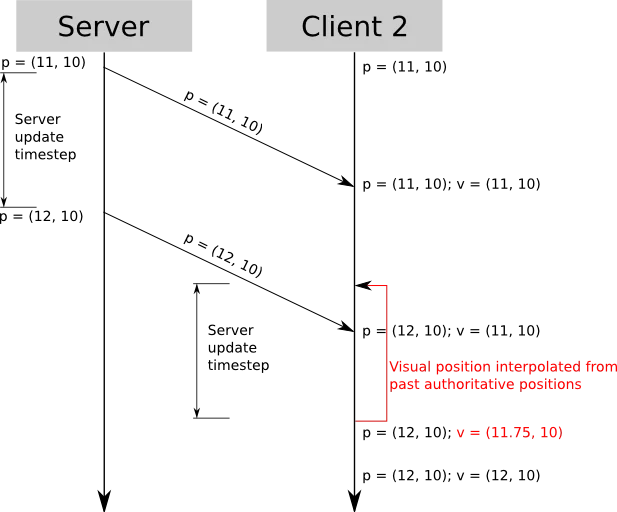

实体插值:在过去中寻找平滑

当你在游戏中看到其他玩家的角色平滑移动时,你可能不知道:你看到的永远是过去。

Gabriel Gambetta解释了这个悖论:

“What you do have is authoritative position data every 100ms. The trick is how to show the player what happens in between. The key to the solution is to show the other players in the past relative to the user’s player.”

假设服务器每100毫秒发送一次状态更新。客户端收到t=1000ms的状态时,它不应该立即显示,而是应该等待一段时间,确保收到了足够多的历史状态,然后在它们之间进行插值。

这意味着玩家看到其他角色时,实际上是"延迟"了100-200毫秒的过去状态。但对于快节奏游戏来说,这个延迟通常不被察觉。

Glenn Fiedler在实现快照插值时发现了一个有趣的现象:

“Experimentally I’ve found that the amount of delay that works best at 2-5% packet loss is 3X the packet send rate. At 10 packets per-second this is 300ms… At 30 snapshots per-second we can get the same amount of packet loss protection with a delay of 150ms. 60 packets per-second needs only 85ms.”

更高的发送频率可以减少插值延迟,但代价是带宽消耗。这是一个典型的工程权衡。

延迟补偿:服务器的时间旅行

当你在FPS游戏中向一个移动的目标射击时,服务器面临一个难题:你的客户端看到的是过去的位置,但目标当前已经不在那里了。

Valve在Source引擎中实现了一个精妙的解决方案:服务器"倒流时间"来验证射击。

“Lag compensation is the notion of the server using a player’s latency to rewind time when processing a usercmd, in order to see what the player saw when the command was sent.”

—— Valve Developer Community

具体实现是这样的:

- 服务器存储每个玩家最近1秒的位置历史

- 当收到射击命令时,服务器计算玩家的延迟

- 将所有其他玩家"倒流"到延迟前的位置

- 在这个"过去的世界"中验证命中

- 恢复到当前时间,应用命中结果

// Source引擎的延迟补偿核心调用

void CMyPlayer::FireBullets(const FireBulletsInfo_t &info)

{

// 开始时间倒流

lagcompensation->StartLagCompensation(this, LAG_COMPENSATE_HITBOXES);

// 在"过去"的世界中验证射击

BaseClass::FireBullets(info);

// 恢复到当前时间

lagcompensation->FinishLagCompensation(this);

}

这本质上是在用计算能力换取公平性。服务器需要为每次射击执行额外的"时间旅行"计算,但玩家获得的是更公平的游戏体验。

时间测量的艺术

在所有这些技术背后,有一个被严重低估的基础设施问题:如何准确测量时间?

Riot Games在为《英雄联盟》实现确定性服务器时,发现他们有8个不同的时钟实现,每个都有微妙的差异:

“Different clock instances would end up running at different rates as the game went on. We even had specialized code in the game that applied magic number multipliers to correct for drift between clock instances.”

—— Rick Hoskinson, Riot Games

这个问题有多严重?当时间测量不准确时,物理模拟会产生漂移,技能冷却会错误,回放系统会失效。Riot最终用几个月的时间重构了整个时间系统,创建了"Unified Clock"。

核心挑战有三个:

浮点精度陷阱:使用32位浮点数累加时间会导致精度损失。当游戏时间达到4000秒时,帧时间(~0.033秒)的细节会被截断。

时钟同步:客户端和服务器的时钟需要精确同步,误差要控制在毫秒级。

单调性保证:许多游戏系统假设时间永远向前,但录像回放功能需要时间能够"倒流"。

Riot的解决方案包括:

class FrameClockFacade

{

public:

// 使用double避免浮点精度问题

double GetFrameStartTimeSecsDbl() const;

double GetElapsedFrameTimeSecsDbl() const;

// 也提供float版本用于性能敏感场景

float GetFrameStartTimeSecs() const;

};

他们还实现了复杂的网络时钟同步算法,通过连续的时间戳采样计算偏移量,并使用统计方法过滤异常值:

offset = ((t2 - t1) + (t3 - t4)) / 2

delay = (t4 - t1) - (t3 - t2)

当检测到时钟漂移时,客户端不会突然跳跃,而是逐渐加速或减速(最多1.3倍)来"追赶"服务器时间。这种调整是如此微妙,以至于玩家几乎察觉不到。

协议选择:UDP vs TCP的永恒争论

在网络协议选择上,游戏开发社区有一个近乎宗教般的分歧。

TCP的优势是可靠性——每个数据包都有确认和重传。但对于实时游戏来说,过时的信息没有重传的价值。如果你在t=100ms时错过了角色位置,到了t=200ms重传这个位置已经毫无意义,因为角色早就移动到别处了。

“In a fast paced environment any information that is not received on first transmission is not worth sending again because it will be too old anyway. As a result the engine relies essentially on UDP/IP.”

—— Fabien Sanglard, Quake 3 Source Code Review

Quake 3的选择非常明确:完全不使用TCP。所有数据都通过UDP传输,可靠性在应用层实现(如果需要的话)。

但这并不意味着TCP完全没有用武之地。对于非实时数据(聊天消息、游戏结束统计),TCP的可靠性模型仍然适用。许多现代游戏采用混合策略:UDP用于实时游戏状态,TCP用于可靠消息。

一个更现代的解决方案是实现自己的可靠UDP层。这让你能够精确控制哪些数据需要确认,哪些可以直接丢弃。

作弊与反作弊:永恒的军备竞赛

网络同步的设计直接影响游戏的反作弊能力。

状态同步的权威服务器模型天然具有反作弊优势。客户端只是一个"显示终端",无法修改游戏逻辑。即使黑客修改了客户端的内存,也无法影响服务器上运行的真实游戏状态。

帧同步则面临更大的挑战。由于每个客户端都在本地计算游戏状态,修改计算过程就可以获得不公平优势。这就是为什么帧同步游戏通常需要额外的反作弊措施:

- 输入验证:服务器检查玩家输入是否合理(移动速度是否超过限制)

- 状态哈希:定期比较所有客户端的游戏状态哈希,检测不一致

- 延迟检测:监控玩家的网络延迟模式,识别"延迟开关"作弊

“A lag switch is a way to cause interruptions in the player’s connection. These interruptions confuse the other clients, which are not able to smoothly interpolate between positions.”

—— Quora讨论

延迟开关作弊利用了插值机制的弱点:当玩家的连接断开时,其他客户端会基于最后已知状态进行外推,导致角色出现在"不可能"的位置。

现代游戏引擎的实现

了解理论之后,让我们看看现代游戏引擎如何实现这些概念。

Unity Netcode for GameObjects

Unity采用了经典的客户端-服务器模型,核心概念包括:

- NetworkObject:标记需要网络同步的游戏对象

- NetworkVariable:自动同步的变量类型

- RPC (Remote Procedure Call):用于执行远程函数

Unity的客户端预测通过NetworkTransform组件实现,它会自动处理位置的预测和和解。

Unreal Engine NetCode

Unreal的实现更加底层,提供了更细粒度的控制:

- Replication System:控制哪些数据需要同步

- Actor Replication:基于Actor的网络同步

- Property Replication:自动同步UProperty标记的变量

Unreal的一个重要特性是ReplicationGraph,它允许开发者精确控制哪些Actor应该同步给哪些客户端,这对于大规模游戏至关重要。

技术选型指南

根据你的游戏类型,应该如何选择同步策略?

RTS游戏(策略类、大量单位):

- 帧同步是首选

- 带宽需求极低,适合大规模战斗

- 必须投入大量精力确保浮点确定性

- 限制跨平台联机(或放弃帧同步)

FPS/TPS游戏(射击类、少量玩家):

- 状态同步配合客户端预测

- 需要实现延迟补偿

- 带宽消耗较高,但可以接受

- 服务器成本是主要考量

MOBA游戏(中等玩家数、复杂状态):

- 混合模式:游戏逻辑状态同步,移动使用预测

- League of Legends的实践证明了这种模式的可行性

- 需要精心设计带宽优化

格斗游戏(2人、帧精确要求):

- 帧同步配合回滚网络代码

- GGPO(Good Game Peace Out)开创了回滚技术

- 客户端预测多个可能的未来,收到对手输入后回滚到正确的历史

性能优化实战

无论选择哪种架构,性能优化都是关键。

带宽优化:

- Delta压缩:只发送变化的部分

- 量化:降低数值精度(位置用16位整数而非32位浮点数)

- 优先级系统:远处的对象更新频率更低

计算优化:

- 空间分区:只同步玩家附近的对象

- LOD(Level of Detail):远处对象使用简化状态

- 增量更新:不是每帧都发送完整状态

延迟优化:

- 预测:提前计算可能的结果

- 插值:平滑处理网络抖动

- 缓冲:吸收网络波动

未来的挑战

随着云游戏、跨平台联机、大规模MMO的发展,网络同步面临新的挑战:

云游戏:游戏逻辑在服务器运行,客户端只接收视频流。这彻底改变了网络同步的范式——不再需要传输游戏状态,但延迟变成了视频编码和网络传输的总和。

跨平台联机:不同平台的性能差异、输入方式差异、帧率差异都会影响同步。需要设计更灵活的同步机制。

大规模MMO:当数千玩家同时在线时,传统的广播模式不再适用。需要实现智能的感兴趣区域管理和动态分区。

写在最后

实时游戏的网络同步是计算机科学中最迷人的领域之一。它需要同时解决物理层的延迟问题、数学层的确定性问题、工程层的性能问题,以及设计层的公平性问题。

从Quake开创的客户端-服务器模型,到RTS游戏的帧同步创新,再到现代FPS的延迟补偿,每一代工程师都在前人的基础上推进技术边界。而这些技术的核心权衡——带宽vs延迟、确定性vs灵活性、公平性vs响应速度——始终贯穿其中。

当你下次在游戏中完成一次精彩的操作,不妨想想:在那短短的几百毫秒内,你的客户端预测了多少次未来?服务器回溯了多少次过去?又是多少工程师的智慧,让你感觉不到这一切正在发生?

参考文献:

- Gabriel Gambetta, “Fast-Paced Multiplayer” series

- Glenn Fiedler, “Gaffer On Games” - Snapshot Interpolation & Floating Point Determinism

- Fabien Sanglard, “Quake 3 Source Code Review: Network Model”

- Rick Hoskinson, Riot Games - “Determinism in League of Legends: Unified Clock”

- Valve Developer Community - “Lag Compensation”

- IEEE 754-2008 Standard for Floating-Point Arithmetic

- David Goldberg, “What Every Computer Scientist Should Know About Floating-Point Arithmetic”

- Tim Ford, GDC 2017 - “Overwatch Gameplay Architecture and Netcode”

- Jon Watte, GameDev.net forums - Floating Point Determinism discussion

- Elijah Emerson, Gas Powered Games - SupCom/Demigod networking implementation