2022年,GPTQ论文报告了一个令人惊讶的结果:将OPT-175B模型从FP16量化到INT4后,困惑度从8.34上升到8.37,增幅仅为0.36%。这意味着将模型体积压缩75%,性能几乎不损失。

更反直觉的是,这种"压缩魔法"并非特例。在LLaMA-7B上,INT4量化(AWQ方法)在多个基准测试上保持了接近原始模型的性能。在BLOOM-176B上,INT4量化后的困惑度从8.11变为8.21,增幅仅为1.2%。

这违背直觉的地方在于:INT4只能表示16个不同的值——-8到7的整数。用如此粗糙的分辨率去表示原本由32位浮点数精确刻画的权重,怎么可能不造成灾难性的信息损失?

答案指向了神经网络量化技术的三重数学真相:神经网络的冗余性、权重分布的特殊性、以及硬件架构的适配性。

量化是什么:从连续到离散的映射

量化的本质是一个映射函数,将连续或高精度的数值映射到离散或低精度的表示。在神经网络的语境下,这个映射可以形式化为:

$$x_q = \text{round}\left(\frac{x}{s} + z\right)$$其中$x$是原始值,$x_q$是量化后的整数值,$s$是缩放因子(scale),$z$是零点(zero point)。反量化过程则为:

$$\hat{x} = (x_q - z) \times s$$这个看似简单的公式背后,是两种截然不同的设计哲学。

对称量化假设数据围绕零点对称分布,此时$z=0$,量化范围为$[-2^{b-1}, 2^{b-1}-1]$,其中$b$是比特数。缩放因子计算为:

$$s = \frac{\max(|x|)}{2^{b-1}-1}$$非对称量化则允许零点偏移,量化范围为$[0, 2^b-1]$或$[-2^{b-1}, 2^{b-1}-1]$。缩放因子和零点的计算为:

$$s = \frac{\max(x) - \min(x)}{2^b-1}$$$$z = \text{round}\left(-\frac{\min(x)}{s}\right)$$

上图展示了对称与非对称量化的核心差异。对称量化中,零点始终位于量化范围的中心,计算简单但可能浪费量化范围;非对称量化通过调整零点来更好地适应数据分布,但增加了计算复杂度。

量化误差(Quantization Error)定义为原始值与反量化值之间的差异:

$$e = x - \hat{x}$$在均匀量化下,假设量化误差均匀分布在$[-s/2, s/2]$,则量化误差的方差为:

$$\sigma_e^2 = \frac{s^2}{12}$$这个简单的公式揭示了一个重要结论:缩放因子$s$越大,量化误差越大。而$s$的大小取决于数据范围——这就是outliers成为量化噩梦的数学根源。

为什么量化效果这么好:三重真相

真相一:神经网络的冗余性

深度神经网络被设计为过度参数化的系统。2019年,Zhu等人通过实验发现,在许多任务上,模型可以安全地剪枝90%以上的参数而不显著影响性能。这种冗余性为量化提供了理论依据:如果模型有大量"冗余"参数,那么降低每个参数的精度似乎也是合理的。

更深入的分析来自对损失函数景观的研究。量化感知训练(QAT)的核心洞察是,训练过程应该引导模型进入"宽"极小值,而非"窄"极小值。在"宽"极小值附近,权重的微小扰动不会导致损失的剧烈上升,这意味着模型对量化误差有更高的容忍度。

真相二:权重分布的特殊性

神经网络权重的分布远非均匀的。对LLaMA-65B的分析显示,权重高度集中在零附近,呈现类似正态分布或拉普拉斯分布的形态。这种分布意味着大部分权重位于零附近的小范围内,只有少数权重具有较大幅度。

对于均匀分布的INT8,其表示能力均匀分布在$[-128, 127]$范围内;而浮点数格式(如FP8)则在零附近提供更高的精度,更符合神经网络权重的实际分布。

这正是为什么FP16、BF16、FP8等浮点格式在深度学习中表现优于同等比特数的整数格式的原因。它们将更多的"分辨率"分配给了权重密集的区域,而非均匀地分配在整个数值范围内。

进一步的优化是NF4(NormalFloat4),一个专门为正态分布权重设计的4比特格式。NF4通过构建一个使正态分布的累积分布函数等间距分布的码本,最小化对正态分布权重的量化误差。

真相三:硬件架构的适配性

量化之所以能在实践中取得成功,离不开硬件的协同演进。现代GPU(如NVIDIA Volta及以后架构)配备了INT8 Tensor Core,专门用于低精度矩阵乘法。INT8乘累加(FMA)操作比FP32节省约10倍能耗和面积,比FP16节省约4倍。

硬件效率提升的核心原因在于电路复杂度的差异。整数加法器的复杂度约为$O(n)$,乘法器约为$O(n^2)$,其中$n$是比特数。而浮点运算需要额外的对齐、归一化等操作,累积过程尤其复杂。研究表明,FP8 FMA比INT8 FMA需要多40-50%的硅面积和更高的能耗。

量化技术的演进:从Binary Network到INT4

量化技术的历史可以追溯到1990年代的信号处理领域,但其在深度学习中的应用始于2015年。那一年,Courbariaux等人提出了BinaryConnect,将权重量化为+1或-1两个值。这是极端量化的首次尝试,证明了神经网络可以在极低精度下工作。

2016年,Zhou等人提出DoReFa-Net,将量化扩展到权重、激活和梯度的训练过程中。同年,Zhu等人提出Ternary Weight Networks(TWN),将权重量化为{-1, 0, +1}三个值,发现添加"零"这个选项能显著提升性能。

对于7B参数的模型,FP32需要28GB内存,INT8降至7GB,INT4进一步降至3.5GB。这种压缩效果使得大模型能够在消费级硬件上运行。

2022年是量化技术的转折点。Dettmers等人发表LLM.int8()论文,首次成功将175B参数模型量化到INT8,核心贡献是发现了大模型中activation outliers的特殊模式,并提出了混合精度量化方案。

2023年,Frantar等人提出GPTQ,将量化的边界推进到INT4和INT3。GPTQ的核心创新是使用海森矩阵(损失函数的二阶导数)来指导权重的量化顺序和误差补偿。Lin等人提出AWQ(Activation-aware Weight Quantization),通过分析激活分布来识别"重要"权重,并对其进行保护性缩放。Xiao等人提出SmoothQuant,通过数学等价变换将激活的outlier"平滑"到权重上,解决了激活量化的难题。

2024年,Wang等人提出BitNet b1.58,将权重表示为{-1, 0, +1}三值,发现仅1.58比特的权重表示就能在特定规模(>30B参数)上接近FP16性能。

核心挑战:Outliers与误差补偿

量化的核心难题可以归结为一个词:outliers。

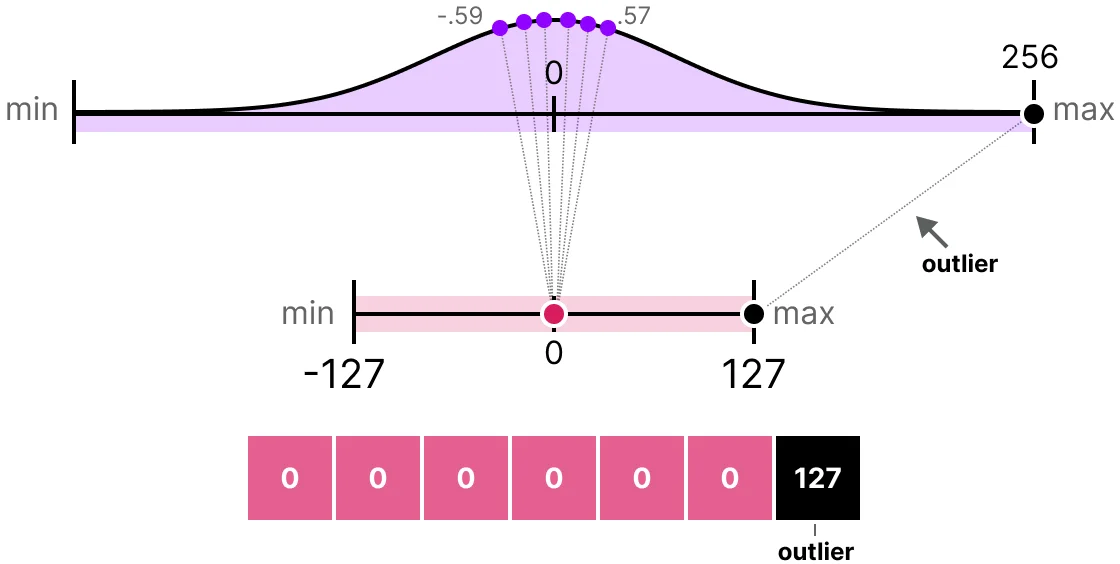

在理想情况下,权重和激活都集中在零附近的小范围内,量化误差可控。但大语言模型展现出一个特殊现象:少数激活值可能比其他值大100倍以上。这些outlier会"拉扯"整个量化范围,导致大部分正常值的量化精度被"稀释"。

当数据范围被少数极大值主导时,大部分正常值会被压缩到量化的最低位,丧失区分度。解决方案之一是"裁剪"(clipping),即忽略极端outlier,将量化范围限制在更合理的区间内。

LLM.int8():向量级量化与混合精度

Dettmers等人在LLM.int8()中提出了两个关键创新:

向量级量化(Vector-wise Quantization):为向量的每个维度计算独立的缩放因子,而非整个矩阵共享一个缩放因子。这允许不同维度根据其数值范围调整量化精度。

混合精度处理:对于outlier维度(通常占所有维度的0.1%左右),保持FP16精度;对于其他维度,使用INT8量化。这种方案在几乎不增加计算开销的情况下,解决了outlier问题。

实验结果显示,LLM.int8()在BLOOM-176B上的困惑度上升仅为0.1%,但代价是推理速度下降15%-23%(因为需要额外的outlier检测和混合精度计算)。

GPTQ:海森矩阵指导的误差补偿

GPTQ的核心思想是:量化的误差不应该均匀分配,而应该根据权重对输出的"重要性"进行加权补偿。

对于一个线性层$Y = WX$,权重$W$的第$i$列$w_i$对输出的影响可以通过海森矩阵$H = X^TX$的对角元素$H_{ii}$来衡量。$H_{ii}$越大,表示$w_i$的变化对输出影响越大,因此在量化$w_i$时产生的误差更应该被补偿到其他权重上。

GPTQ的算法流程如下:

- 计算海森矩阵$H = X^TX$并求逆$H^{-1}$(实际使用Cholesky分解加速)

- 按列遍历权重矩阵

- 对于每一列$w_i$,量化为$\hat{w}_i$,计算量化误差$\delta_i = w_i - \hat{w}_i$

- 将误差按海森矩阵加权重分配到后续列:$w_j \leftarrow w_j - \delta_i \cdot \frac{H_{ij}}{H_{ii}}$ for $j > i$

这个过程本质上是将量化误差按"重要性"分散到其他权重上,使得整体输出保持不变。论文证明,GPTQ等价于Babai算法(Babai’s nearest plane algorithm),一个经典的格点近似算法。

实验数据显示,GPTQ在OPT-175B上实现了INT4量化后困惑度仅上升0.36%(从8.34到8.37),且量化过程仅需约4小时GPU时间。相比之下,简单的四舍五入(RTN)方法导致困惑度上升到10.54,性能显著下降。

AWQ:激活感知的重要性权重

AWQ的核心洞察是:权重的"重要性"不应该由权重本身的幅度决定,而应该由其对应激活的幅度决定。

考虑一个简单的例子:假设权重$w_1 = 0.01$和$w_2 = 100$,看起来$w_2$更重要。但如果激活$a_1 = 1000$而$a_2 = 0.001$,那么$w_1 \cdot a_1 = 10$的贡献远大于$w_2 \cdot a_2 = 0.1$。因此,$w_1$才是真正"重要"的权重。

AWQ通过以下步骤识别并保护重要权重:

- 使用校准数据计算激活幅度的均值$\mu_a$

- 对于激活幅度大的通道,识别其对应的权重为"重要权重"(salient weights)

- 对重要权重应用保护性缩放:放大权重,同时缩小对应的激活,保持数学等价性

- 对缩放后的权重进行量化,重要权重因为被放大而获得更高的量化精度

实验表明,仅保护1%的重要权重就能显著降低量化误差。AWQ在LLaMA系列模型上的INT4量化表现优异,在多个基准测试上接近原始模型性能。

SmoothQuant:激活outlier的平滑迁移

SmoothQuant的出发点是:激活中的outlier难以量化,但权重相对"干净"。能否通过数学变换,将激活的outlier"迁移"到权重上?

答案是肯定的。对于一个线性层$Y = XW$,可以引入一个对角矩阵$S$:

$$Y = (XS^{-1})(SW) = \hat{X}\hat{W}$$这个变换在数学上完全等价,但$\hat{X}$的outlier被缩小了,$\hat{W}$的范围变大了。关键是选择合适的$S$。

SmoothQuant提出的公式是:

$$s_j = \frac{\max(|X_{:,j}|)^\alpha}{\max(|W_{j,:}|)^{1-\alpha}}$$其中$\alpha$是一个超参数,通常取0.5。当$\alpha = 1$时,所有outlier都被迁移到权重;当$\alpha = 0$时,不进行迁移。$\alpha = 0.5$是一个折中,平衡了激活和权重的量化难度。

SmoothQuant的优势在于其简单性:它不需要复杂的误差补偿或重要性分析,仅需一个线性变换,就能显著改善激活量化的效果。实验显示,SmoothQuant+INT8量化在LLaMA系列模型上几乎不损失精度。

量化的边界:什么时候会失败

量化并非万能药。在某些情况下,量化会导致灾难性的性能下降。

极低比特的局限:当比特数降至2-bit或更低时,量化误差急剧增加。研究表明,PTQ方法在2-bit下通常会导致模型性能崩溃。即使是GPTQ,在OPT-175B上的INT2量化也会导致困惑度显著上升。这源于INT2仅能表示4个不同的值{-2, -1, 0, 1},信息容量严重不足。

特定任务的敏感度:不同任务对量化的敏感度差异巨大。一项研究发现,在agent风格的基准测试中,4-bit量化可能导致10%-15%的任务成功率下降,即使其他指标(如困惑度)下降不明显。这表明某些能力(如复杂推理)可能依赖于模型中的精细数值模式,而这些模式对量化误差高度敏感。

训练与推理的断层:训练通常使用FP16或BF16,推理时量化到INT8或INT4。这种精度断层可能导致训练时学到的特征在量化后失效。量化感知训练(QAT)通过在训练过程中模拟量化误差来缓解这个问题,但代价是训练成本增加。

非Transformer架构:量化技术在Transformer架构上取得了巨大成功,但对于其他架构(如CNN、RNN)的效果参差不齐。某些操作(如BatchNorm、ReLU)对量化敏感,可能需要特殊处理。

从PTQ到QAT:精度与成本的权衡

量化方法可以分为两大类:训练后量化(Post-Training Quantization, PTQ)和量化感知训练(Quantization-Aware Training, QAT)。

PTQ直接对训练好的模型进行量化,无需重新训练。优点是成本低,缺点是可能损失精度。GPTQ、AWQ、SmoothQuant都属于这一类。

QAT在训练过程中模拟量化误差,让模型"学会"适应低精度。优点是精度更高,缺点是训练成本增加。

QAT的核心技术是"假量化"(fake quantization):在前向传播时,先量化再反量化,引入量化误差;在反向传播时,使用直通估计器(Straight-Through Estimator, STE)绕过不可微的量化操作,直接传递梯度。

$$\frac{\partial L}{\partial x} \approx \frac{\partial L}{\partial \hat{x}}$$其中$\hat{x}$是量化后反量化的值。这个近似忽略量化误差,但实践中效果良好。

QAT的一个有趣现象是"宽极小值":训练过程中,模型会倾向于寻找对量化误差不敏感的解,这对应于损失函数景观中的"平坦"区域,而非"尖锐"的极小值。

硬件的支持与限制

量化的成功离不开硬件的配合。现代硬件对不同数值格式的支持程度差异巨大。

INT8是当前最成熟的支持格式。NVIDIA Volta及以后的GPU配备了INT8 Tensor Core,Intel Cascade Lake及以后的CPU支持VNNI(Vector Neural Network Instructions),ARMv8.2及以后的CPU支持dot product指令。INT8矩阵乘法相比FP32可以提供4-8倍的吞吐量提升和显著的能耗降低。

INT4的支持正在发展。NVIDIA Ada Lovelace架构开始支持INT4 Tensor Core,但软件生态仍不完善。Qualcomm Hexagon等边缘计算芯片已经支持INT4运算。

FP8是2023年兴起的新格式,NVIDIA Hopper架构的Transformer Engine、Intel的AMX都支持FP8训练和推理。FP8在保持接近FP16精度的同时,提供了类似INT8的效率。但FP8的标准化仍在进行中,OCP标准与各家厂商的实现存在细微差异。

混合精度是当前硬件的主流设计。例如,NVIDIA H100的Transformer Engine支持FP8训练,但权重更新需要在FP32中进行,因为小的梯度更新可能被低精度舍入为零。这要求硬件支持多种格式的转换和存储。

未来方向:更少的比特,更智能的压缩

量化技术的边界仍在不断拓展。几个值得关注的方向:

FP8的崛起:FP8提供了比INT8更好的动态范围,同时保持了类似的计算效率。2024年,DeepSeek-V3使用FP8训练了671B参数的模型,证明了FP8在超大规模模型上的可行性。

Block-wise量化:将权重分组,每组使用独立的缩放因子,可以在不增加比特数的情况下显著提升精度。Microsoft的MSFP、OCP的Microscaling Formats都是这一思路的实例。

学习的量化参数:传统量化方法中,缩放因子和零点由数据统计得到。近期研究提出将这些参数作为可学习的变量,通过端到端训练优化,代表工作包括LSQ(Learned Step Size Quantization)。

极低比特的突破:BitNet b1.58证明了1.58比特权重在特定规模模型上可以接近FP16性能,核心洞察是三值权重{-1, 0, +1}可以将矩阵乘法简化为加法和减法,极大提升计算效率。但这一方法目前仅适用于>30B参数的模型,小模型的性能差距仍然显著。

硬件-软件协同设计:未来的量化技术需要与硬件架构深度耦合。例如,为特定量化方案设计专用加速器,或在编译器层面优化量化模型的执行调度。这一方向需要跨学科合作,但潜力巨大。

结语

量化技术的成功并非偶然,它揭示了神经网络的一个深层特性:模型的能力主要来自其拓扑结构(神经元之间的连接方式)和权重的相对大小关系,而非权重的绝对精度。这使得我们可以在损失极少信息的情况下,将模型压缩到原始大小的1/4甚至更小。

从FP32到INT4,量化技术走过了一条从理论探索到工程实践的道路。LLM.int8()发现了outlier的特殊模式,GPTQ引入了海森矩阵指导的误差补偿,AWQ提出了激活感知的重要性权重,SmoothQuant实现了激活outlier的平滑迁移。这些算法的演进,共同推动着量化的边界不断向前。

但量化的边界仍然存在。2-bit量化的性能崩塌提醒我们,信息压缩是有极限的。特定任务的敏感度差异表明,某些能力依赖于精细的数值模式。硬件支持的参差不齐意味着,算法创新需要与硬件协同演进。

量化技术的下一个十年,可能不再是简单地减少比特数,而是更智能的压缩:根据重要性分配精度,根据硬件定制格式,根据任务优化策略。无论如何,量化已经从一种"权宜之计",成为模型部署的核心技术。在算力成本日益高涨的今天,让大模型在有限资源上高效运行,量化技术功不可没。